Le marché des noms de domaine et la longue traîne...PréambuleLe marché des noms de domaineLes noms de domaine et la longue traîneBrève conclusionPréambuleComme je vous l'annonçais dans un précédent

billet, c'est la semaine dernière que s'est tenue la

conférence de l'ICANN à Marrakech. J'en profite pour adresser un salut amical aux lectrices et lecteurs d'Afrique du Nord qui viennent souvent me rendre visite sur ce blog. :-)

En cliquant sur la caricature ci-dessous (l'ICANN en plein travail), vous téléchargez un PDF avec une présentation succincte des sessions.

J'ai profité de ce week-end pour parcourir les retranscriptions des réunions qui ont eu lieu, vraiment riches tant de par l'ampleur et la variété des sujets traités, que de la qualité des intervenants. Ça ne vous étonnera pas si j'ai décidé d'approfondir en premier l'atelier consacré au

marché des noms de domaine :

Domain Name Marketplace Workshop. Voir

la table des matières. Sans entrer dans les détails du cycle de vie d'un nom de domaine, de l'historique et l'évolution de ce marché ou autre, je préfère tenter une synthèse des éléments clés qui se dégagent de cette session, tels que je peux les percevoir. Je vous donne également la liste des participants auxquels je fais référence dans ce bref exposé :

Toutefois, pour bien comprendre les propos qui suivent, rappelons d'abord quelques notions :

- l'Add Grace Period est un délai de grâce de 5 jours concédé par l'ICANN à toute personne qui, s'apercevant d'une erreur d'enregistrement, peut annuler la procédure et récupérer sa mise ;

- l'Add-drop scheme est « le modèle j'essaie - je prends/je jette », à savoir que j'enregistre le domaine et je le mets sur une page parking, puis si je vois que le trafic (essentiellement en saisie directe, ou type-in) peut devenir rentable je le prends, sinon je le « jette » et l'ICANN me rembourse obligeamment mes frais d'enregistrement ;

- dans le contexte du domain tasting, ou domain kiting, le verbe Add signifie qu'un domaine est « ajouté » au système de Registre commun (SRS - Shared Registry System) ;

- le Registre, ou Registry, est l'entité chargé de gérer les TLD, ou Top Level Domain : Verisign pour le .COM et le .NET, PIR pour le .ORG, Afilias pour le .INFO, etc. ;

- le Registreur, ou Registrar, est le centre ou bureau d'enregistrement qui sert d'intermédiaire entre le Registre et l'utilisateur final qui enregistre un nom de domaine ;

- l'enregistreur, ou Registrant, est l'utilisateur final pour le compte duquel est enregistré le nom de domaine ;

- l'ICANN est l'entité « chargée d’allouer l’espace des adresses de protocole Internet (IP), d’attribuer les identificateurs de protocole, de gérer le système de nom de domaine de premier niveau pour les codes génériques (gTLD) et les codes nationaux (ccTLD), et d’assurer les fonctions de gestion du système de serveurs racines ».

[Début]* * *

Le marché des noms de domaineJothan Frakes introduit la session et souligne, parmi les thèmes abordés, les nombreuses façons de monétiser les noms de domaine, l'évolution du marché des noms de domaine ces dernières années, et l'adéquation de certaines des activités liées à la monétisation, avant de passer la parole à

Tim Cole, de l'

ICANN, qui évoque timidement la pratique du taste-domaines :

...many people are using that period to test a name or the term has been coined to taste a domain name to determine whether or not it has monetization value.

...nombre de personnes utilisent le délai de grâce pour tester un nom de domaine (indépendamment de la manière dont on peut qualifier cette pratique), afin de déterminer si un domaine a une valeur ou non en termes de monétisation.

John Berryhill prend la parole :

Je voudrais brièvement décrire les forces du marché qui pilotent les intérêts spéculatifs derrière le commerce des noms de domaine, puis aborder le phénomène du taste-domaines (ou comme on voudra bien l'appeler), des pratiques qui évoluent plus vite que le développement des politiques par l'ICANN.

Autrefois le modèle classique de monétisation d'un nom consistait à enregistrer le domaine pour le revendre plus cher ensuite, une pratique largement marginale par rapport à la spéculation sur les noms que nous connaissons aujourd'hui.

Cet héritage nous vient du début des années 90, lorsque différents acteurs commencèrent à accumuler un grand nombre de domaines dans l'attente de les revendre. La question leur vint alors naturellement : que faire de ces domaines entre-temps ?

Certains noms génériques ont une valeur simplement en fournissant des liens vers des sites marchands qui vendent des produits associés à ces noms et grâce au trafic qu'ils envoient vers ces sites.

L'une des approches consiste à dire que ces pages Web truffées de liens sponsorisés sont sans contenu réel, pour autant l'internaute y trouve des liens pertinents le renvoyant vers des vendeurs de produits qui l'intéressent. On appelle ce type de publicité au coût par clic (payé par l'annonceur). C'est de là que vient le phénomène des enchères sur les mots clés, dont la valeur peut être déterminée dans une fourchette allant de quelques centimes à 50 $ pour un terme comme « mésothéliome », sur lequel, contrairement à ce qu'on pourrait croire, ce ne sont pas les médecins mais les avocats qui enchérissent le plus !

Selon

Roberto Gaetano, du

comité ALAC de l'ICANN :

...il est vrai que le manque de règles de base et l'absence de clarté au niveau des règles existantes permettent l'émergence de ce type de détournements. Nous sommes dans une situation proche du Far-West (a kind of a wild west situation). Raison pour laquelle, parmi les tentatives de mise en ordre, nous regardons avec un certain intérêt la proposition ainsi nommée de la « longue traîne »...

Quant à la distinction faite entre les sites Web avec du contenu et les sites sans contenu, du point de vue de l'utilisateur je ne pense pas qu'il y ait des sites avec contenu et des sites sans ; en revanche il y a des sites qui fournissent des services et des sites qui n'en fournissent aucun. Toujours du point de vue de l'utilisateur, la chose la plus importante est de trouver ce que l'on cherche en effectuant le moins de clics possible. Donc le problème n'est pas que l'on ait des sites vides ou pleins de contenu, mais de savoir si ces sites fournissent des services et donnent des informations utiles (quand bien même ils redirigent vers un site où se trouve l'information que recherche l'utilisateur).

Mme Sarah Deutsch aborde le problème du typosquatting et de la déclinaison d'une centaine de noms typosquattés (variations orthographiques de Verizon) détenus par

eNom (ce dont se défend

Paul Stahura...), en faisant un parallèle avec l'affaire

Dotster. Elle conclut en soulignant le rôle que pourrait tenir l'ICANN dans cette affaire, notamment aux termes du chapitre dédié aux

Obligations générales du Registreur de la convention d'accréditation passée entre l'ICANN et les registreurs (RAA - REGISTRAR ACCREDITATION AGREEMENT, II.D.ii:

prohibitions on warehousing of or speculation in domain names by registrars).

Pat Kane, de

VeriSign, commence en disant que les chiffres qu'il fournira sont approximatifs du fait que les registreurs ont des lignes de crédit ouvertes chez Verisign... Et de continuer en soulignant qu'originellement le système n'a pas été conçu pour traiter 1,7 million d'enregistrements par jour ! Donc en mettant sur un plateau de la balance les 6 $ encaissés par nom de domaine, et sur l'autre les coûts indispensables pour supporter et mettre à jour l'infrastructure matérielle énorme nécessaire pour traiter quotidiennement cette masse d'opérations, nous n'avons pas encore analysé si nous gagnons ou si nous perdons de l'argent.

(...)

Sur ce que Verisign nomme l'

add storming (l'assaut des ajouts), Kane rappelle que chaque jour ce sont grosso modo

120 millions de demandes d'ajouts qui arrivent pour tenter de s'accaparer les domaines arrivant à expiration, la plupart de ces demandes ayant lieu entre 13h30' et 15h30'. La raison en est que les registreurs ont analysé notre programme d'effacement, en estimant combien nous pouvions en traiter par minute et en analysant ce qui se passait durant ces 60 secondes ! Donc au lieu de transmettre une seule demande, ils les envoient par paquets sans vraiment attendre la réponse individuelle à chacune, juste pour essayer d'arriver avant les autres.

Sur tous les noms effacés journellement, nous avons

en moyenne 2,276 tentatives de réenregistrement par nom, et 99,9 % des domaines effacés qui sont immédiatement réenregistrés.

À ce propos,

John Berryhill remarque que Verisign ne se prononce pas sur le

domain kiting et observe d'un ton caustique que la société semble incapable de déterminer si elle en retire un profit ou non... Par conséquent, le problème de savoir si le détournement du délai de grâce est un abus ne se pose pas, du moment que les différentes clauses contractuelles sont respectées... (Pragmatique !)

Jothan Frakes interrompt la discussion en cours pour donner des statistiques sur le phénomène, rapportées au mois de mai 2006 (du 1er au 31) aux .COM et .NET. Durant cette période :

- 616 registreurs ont ajouté des domaines au système (selon Steve Crocker, présent dans l'assemblée, seuls un tiers sont de véritables compagnies, les autres ayant été créées uniquement dans le but d'avoir accès au système pour l'exploiter) ;

- sur l'ensemble, 502 registreurs ont profité du délai de grâce, soit 81 % ;

- chez 322 registreurs, le taux d'effacement a été supérieur à 5 % ;

- 87 enregistreurs ont enregistré le même nom de domaine plus d'une fois, avec au total un résultat brut de 5,2 millions d'ajouts dans le système ;

- en tout, ce sont 30 millions de noms uniques qui ont été ajoutés au mois de mai, dont 38 600 domaines ont été enregistrés - effacés - réenregistrés six fois ou plus ;

- 55 registreurs ont enregistré des noms avec un taux d'enregistrement dépassant un seuil spécifique :

- 17 avec un taux d'effacement inférieur à 1,3 % ;

- 29 avec un taux supérieur à 97 % ;

- 18 représentent plus de 98,1 % de l'ensemble des opérations ;

- Et je pense que ces chiffres sont fiables (And I believe these numbers to be accurate.)

Tim Ruiz, de

Go Daddy, donne aussi l'exemple des requêtes interceptées (vous cherchez un nom disponible, vous en trouvez un, et pour peu que vous ne l'enregistriez pas de suite, lorsque vous réessayez plus tard, le domaine n'est plus disponible, quelqu'un, quelque part, ayant intercepté votre requête et l'ayant enregistré dans les secondes suivantes au profit d'un registreur). Selon lui, « tout le monde le sait, vous le savez, nous le savons, l'ICANN le sait » (...

[registrars] know it, you know it, we all know it, ICANN knows it.), et il serait temps de demander une intervention du gouvernement américain. « Cela va trop loin et dure depuis trop longtemps » (

This has gone too long and too far)...

Rob Hall, de

Momentous, maison mère de Pool.com, leader mondial du second marché des noms de domaine (espèce de Bourse aux domaines), précise :

Tout d'abord l'ICANN n'a pas instauré le délai de grâce, ça existe depuis une dizaine d'années, et aujourd'hui l'ICANN est chargé de gérer le système, qui est devenu extrêmement sophistiqué. Or les méthodes utilisées pour l'exploiter sont très créatives et conduisent à de nouveaux business models. De même que la compétition porte à l'innovation.

Concernant la taille réelle de ce marché, nous avons vu qu'en gros il y a 18 registreurs impliqués dans ces pratiques. S'agissant d'un nombre plutôt restreint, mon opinion est qu'il va vite y avoir une autorégulation du phénomène. Ceci étant, il est clair que la demande existe pour ce type de marché et d'activité. J'ai entendu parmi les participants des termes tels qu'abus, détournement, vol, fraude (kiting), or la fraude est un délit. D'après moi l'emploi d'un tel vocabulaire n'est bon qu'à enflammer les esprits, là où il faudrait au contraire présenter les choses différemment et éduquer la communauté...

Jon Nevett, de

Network Solutions, reconnaît que certains signes témoignent clairement que l'exploitation du système a des conséquences inattendues que personne n'avait prévues.

David Maher, de

PIR, Registre du .ORG, renchérit :

...Certains registreurs enregistrent littéralement des millions de domaines par mois ou par semaine, avec des taux d'effacement qui atteignent 99 %, ce qui représente une charge technique phénoménale pour notre système, alors que nous desservons essentiellement la communauté non commerciale. Or la tendance va croissant, pour des noms qui finissent par être exploités à des fins antisociales... Nous aussi avons prévu de mettre rapidement en place un programme d'éducation et de sensibilisation.

[Début]* * *

Les noms de domaine et la longue traîneNous en arrivons au point d'orgue de cette session, la proposition du modèle de la longue traîne présentée par

Paul Stahura (

eNom). (À noter que ce modèle a été mis au point depuis plus d'un an, puisqu'un premier

livre blanc date de juin 2005, et qu'une

deuxième ébauche a été présentée en avril dernier. Cette dernière version introduit la notion de «

torso »).

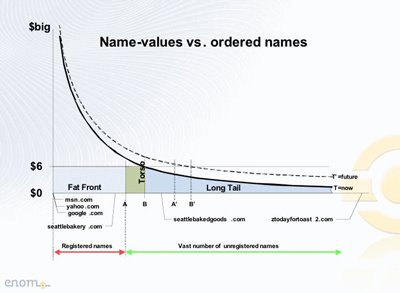

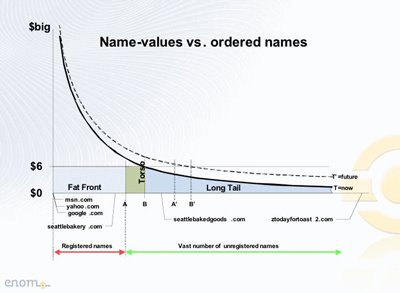

Le modèle est illustré sur le graphique suivant :

où vous avez à gauche un large front (

fat front), qui correspond aux noms de domaine déjà enregistrés, avec à droite un tronc (

torso) et une longue traîne (

long tail) pour les domaines non enregistrés.

En fait, il s'agit d'

une nouvelle catégorie de noms de domaine.

À gauche du graphique, vous avez les domaines qui ont le plus de valeur, et à droite ceux qui en ont le moins, avec entre les deux (entre A et B) une zone que nous appellerons le

tronc, correspondant aux noms qui ne sont pas enregistrés mais dont la valeur dépasse six dollars (

prix payé à Verisign pour chaque nom de domaine en .COM ou .NET - NdT). Quant à la valeur des domaines dans la partie droite de la longue traîne, c'est celle qui peut être déterminée par leur capacité de monétisation au coût par clic.

Donc notre proposition consiste à créer une nouvelle classe de noms de domaine, ayant les critères suivants :

Les domaines actuels correspondent à la classe I, et ils ont les caractéristiques que nous leur connaissons tous aujourd'hui. Les domaines de classe II sont des domaines d'un nouveau genre, pour lesquels

le délai de grâce ne serait plus de 5 jours mais pourrait aller jusqu'à 365 jours, ce qui veut dire que si vous effacez un domaine pendant cette période vous êtes remboursé.

En théorie, ces nouveaux domaines ne sont associés à aucun serveur de noms (

donc, pas de possibilité de les assigner à un serveur de son choix), mais uniquement à des serveurs spécifiques auxquels ils sont assignés par défaut par le Registre. L'inscription au WhoIs est également requise pour ces noms, avec un enregistreur clairement identifié : le registreur. Pour autant dès qu'un autre sujet les enregistre, à n'importe quel moment, ils passent automatiquement en classe I, en prenant ainsi toutes les caractéristiques afférentes aux noms de cette classe.

Maintenant, pour ce qui concerne le partage des revenus, ils peuvent être stationnés sur une page parking fournie par le Registre. Les flux économiques associés à la monétisation qui viennent de Yahoo, Google ou autres seraient ainsi répartis :

55 % pour le Registre, 5 % pour l'ICANN et 45 % pour le Registreur. De plus, en centralisant tous ces domaines sur un seul site, cela permettrait d'en soigner particulièrement la qualité, différents Registres pouvant également avoir différents sites de recherche.

Par conséquent, si le problème est celui du

domain tasting, ou du

domain kiting, ces nouveaux noms de domaine pourraient être la solution, puisque, de fait, vous n'avez plus besoin de tester les domaines de classe II.

[Début]* * *

Brève conclusionVoilà. Une dernière remarque : selon

Chuck Gomes, de

Verisign, la société serait sur le point d'introduire sa nouvelle politique contractuelle en matière de services du Registre (

the new registry service policy for introducing new registry services is completed, ... and it is close).

Bruce Tonkin rapporte de même que l'Organisme de l'ICANN en charge des noms génériques (

GNSO) est en train de développer une nouvelle approche contractuelle avec les Registres (

a policy for registries to request a change to their contracts to allow changes in the operation of the registry). Donc nous verrons bien la tournure que prendront les choses, et si ce modèle de longue traîne apporte enfin une réponse que

Bob Parsons appelle de tous ses vœux depuis des mois.

Il y aurait encore beaucoup à traduire et à dire, mais cela demande du temps et je n'en ai plus. J'ai commencé un gros projet de traduction qui va m'occuper tout le mois, donc le rythme de publication des billets va forcément ralentir. Toutefois, j'ai ressenti l'urgence d'évoquer l'apparition éventuelle de ces domaines d'un nouveau type, car je n'en ai trouvé aucune trace sur le Web francophone (mais je ne demande qu'à être démenti), même si le premier document qui traite du sujet remonte à juin ... 2005 !

[Début]À +Tags :

Actualités,

Long Tail,

longue traîne,

Paul Stahura,

eNom,

Internet,

Add-drop scheme,

Domain kiting,

Domain tasting,

noms de domaine,

DNs,

monétiser,

monétisation,

type-in,

type-ins,

typos,

typosquatting,

VeriSign,

ICANN,

laboratoire de traduction

Actualités, Google, media, médias, médias sociaux, publicité, marché publicitaire, Long Tail, longue traîne, grande traîne, Internet, Web 2.0

Actualités, Google, media, médias, médias sociaux, publicité, marché publicitaire, Long Tail, longue traîne, grande traîne, Internet, Web 2.0