Les enjeux d’une stratégie de liens

Chapitre IV

Les trois étapes de la mise en œuvre d'une stratégie de liens : Première étape

Chapitre IV

Les trois étapes de la mise en œuvre d'une stratégie de liens : Première étape

Avertissement : ce billet continue la série Stratégie de liens, qui est la traduction française du rapport « Linking Matters ». Pour ceux qui préfèrent, voir le chapitre original ; à noter qu'il peut y avoir quelques différences entre la version anglaise HTML, légèrement réaménagée par son auteur pour la mise en ligne, et la présente version française, qui traduit l'intégralité du rapport au format PDF.

IV. Indice de popularité : quel est votre score ?

Chronologie d’une stratégie de liens

Exercez-vous

1. Liens qui pointent aujourd’hui vers votre site

2. Liens qui pointent vers les sites de vos concurrents

Comment évaluer la qualité des liens ?

Quelle note donneriez-vous à chacun de ces trois liens ?

Tableau d'évaluation des liens ?

Pour mettre en œuvre une stratégie de liens, le temps à investir et les efforts à déployer dépendent des objectifs que vous vous êtes fixés. Vous pouvez décider de n’y consacrer que quelques jours, quelques semaines ou quelques mois, mais indépendamment du temps que vous aurez prévu d’y passer, les étapes à suivre seront toujours les mêmes. Seul change le niveau de détail. Voici donc un tableau du processus et des ressources à mobiliser :

Chronologie d’une stratégie de liens

Comme dans tout projet, une approche méthodique fournira de bien meilleurs résultats. Voici donc la séquence des étapes à suivre pour construire une stratégie de liens optimale.

Première étape de la mise en œuvre d'une stratégie de liens :

1. Liens qui pointent aujourd’hui vers votre site

2. Liens qui pointent vers les sites de vos concurrents

Deuxième étape de la mise en œuvre d'une stratégie de liens :

3. Autres sites susceptibles d’échanger des liens avec le vôtre

4. Raisons pour lesquelles des sites externes voudraient pointer vers vous

5. Objectifs de votre stratégie de liens

6. Convivialité de la procédure d’échange de liens sur votre site

Troisième étape de la mise en œuvre d'une stratégie de liens :

7. Liens que vous pourriez publier sur votre site

8. Demandes de liens entrants

9. Suivi des résultats

Supervision et ajustement de votre stratégie

Supervisez constamment les résultats de votre action et ajustez votre stratégie au fur et à mesure de vos expériences [Début]

Exercez-vous

Nous avons réuni en un fascicule dix exercices pour vous aider à planifier votre stratégie de liens et à la mettre en œuvre. Vous pouvez télécharger directement le document au format Word.

Comme meilleure façon de procéder, nous vous conseillons de lire rapidement l’ensemble du fascicule puis de passer le temps nécessaire sur chaque exercice en respectant la séquence des étapes.

[ Note à la traduction : outre visiter l’un des nombreux moteurs qui permettent de vérifier les indices de popularité, vu que le document original propose d'utiliser Google, Altavista, Hotbot, alors qu'Altavista n'existe plus, qu'Hotbot n'est plus représentatif et que, comme signalé dans un précédent billet, la syntaxe « link:www.monsite.com » de Google n'est pas significative, j'ai sauté l'explication sur ces trois moteurs.] [Début]

1. Liens qui pointent aujourd’hui vers votre site

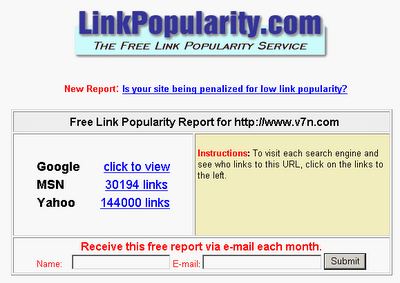

Visitez un site comme www.linkpopularity.com, vous pourrez y tester plusieurs moteurs de recherche à la fois (essentiellement Google, Yahoo et MSN). Enregistrez-vous si vous souhaitez recevoir des mises à jour mensuelles.

Contrôlez ensuite les différents résultats en visitant chacun des sites qui pointent vers vous. Quelle est la nature de ces sites ? Pourquoi font-il pointer un lien vers le vôtre ? Quels sont les autres liens qu’ils proposent ?

Ainsi, l’étude de ces différents sites vous permettra de mieux comprendre le pourquoi du comment, et d’intégrer ensuite cette compréhension dans votre propre stratégie de liens. [Début]

2. Liens qui pointent vers les sites de vos concurrents

Analysez maintenant la situation concernant vos concurrents. Une bonne façon de procéder est d’utiliser un excellent logiciel gratuit, téléchargeable sur www.checkyourlinkpopularity.com. Installez-le puis saisissez votre URL et les adresses Web de vos concurrents, vous obtiendrez le tableau suivant :

Les couleurs vous permettent de visualiser immédiatement l'importance de votre présence, de limitée à exceptionnelle :

Et qu’apprendrez-vous en étudiant la concurrence ? Beaucoup !

- Tout d’abord vous pourrez quantifier le nombre de sites qui pointent vers eux, et apprécier la qualité des liens, dont vous pourrez vous faire une idée de la valeur en termes d’e-marketing. Puis, en partant de l’indice de popularité de vos concurrents, il vous sera facile d’établir un tableau comparatif sur la base duquel mesurer votre propre évolution / amélioration.

- En second lieu, vous pourrez dresser une liste des sites cibles qui pointent vers vos concurrents, susceptibles de devenir pour votre propre site une bonne source de liens entrants potentiels.

- Troisièmement vous aurez une vision élargie des sites externes qui jouent un rôle important dans votre secteur d’activité. En testant l’indice de popularité des principaux sites parmi ceux qui ont des liens avec vos concurrents, vous pourrez repérer de nouveaux partenaires potentiels.

Naturellement, la qualité des liens que vous trouverez sera plus ou moins bonne. [Début]

Comment évaluer la qualité des liens ?

Rien de tel qu’un exemple pour illustrer notre propos :

[ Note à la traduction : naturellement, l’exemple qui suit est caduc, mais je le laisse tel quel car le fonctionnement reste le même. Lien à suivre pour voir l'illustration graphique originale.]

Supposez que vous êtes propriétaire d’un petit hôtel de luxe au cœur de Londres. Vous avez dressé une liste de vos concurrents directs en ligne et vous décidez de tester leur indice de popularité.

« One Aldwych » est l’un des hôtels qui offre des services similaires aux vôtres.

Donc, soit vous utilisez un logiciel gratuit pour vérifier la situation de chacun de vos concurrents, soit vous allez sur un site tel que www.linkpopularity.com. Si vous optez pour cette dernière solution, vous voyez que l’indice de popularité de votre concurrent est de 23 sur AltaVista, de 74 sur Google et de 15 sur Hotbot.

Puis, en activant les liens, vous voyez apparaître l’adresse des sites qui pointent vers onealdwych.com.

Examinons maintenant la valeur qualitative des liens affichés dans Google. Prenons le premier : Wealth24.com se décrit comme étant « le seul et unique répertoire sur le Web dédié au shopping de luxe et à la gestion de fortune ». Ce site propose donc de nombreux liens ne pointant pas uniquement vers des hôtels, mais également vers d’autres fournisseurs de biens et de services de luxe.

En déroulant la liste, vous trouvez ensuite ntlworld.com : il s’agit d’un profil très « people » d’un auteur et présentateur TV célèbre, Alan Titchmarsh. En parcourant l’article, vous découvrez alors qu’il énumère parmi ses lieux de gastronomie préféré le restaurant Indigo, qui se trouve à Onealdwych.

Voyons maintenant un troisième lien. Travelintelligence.net Celui-ci s’annonce très intéressant, puisqu’il liste plus de 70 écrivains touristes qui prodiguent leurs conseils à tous les voyageurs friands d’informations. En jetant un coup d’œil sur la page d’accueil, vous lirez des commentaires tels que celui-ci :

« Présentation d’articles écrits par des touristes extrêmement bien informés qui vous feront découvrir tous les bons coins. Un site incomparable constamment remis à jour, qui fait de l’organisation et de l’accomplissement de vos voyages une aventure riche en surprises. » The Telegraph [Début]

Quelle note donneriez-vous à chacun de ces trois liens ?

Une façon d’y parvenir est de noter chacun des sites d’après son indice de popularité. Toutefois, le plus important est de les examiner vous-même, en visitant un par un ceux qui vous semblent plus intéressants.

- Wealth24.com propose beaucoup de liens vers des fournisseurs de services de luxe, qui englobent aussi les hôtels. On peut donc supposer qu’il serait assez facile d’y placer un lien, même s’il est probable qu’il générera peu de trafic.

- Ntlworld.com n’a pas grand chose à voir avec les hôtels, le lien n’apparaissant que dans le cadre d’une interview accordée par un personnage en vue. Y mettre un lien ne présente aucun intérêt !

- Travelintelligence.net, en revanche, est un magazine en ligne qui vise comme audience cible le monde du voyage. Donc, pour peu qu’il ait un trafic qualifié, un lien pointant de ce site vers le vôtre serait de tout premier choix ! Même s’il vous faudra vraisemblablement consentir des efforts supplémentaires pour obtenir d’abord un meilleur placement dans les moteurs des recherche. [Début]

Vous obtenez donc un tableau tel que celui-ci :

Progrès réalisés

À la fin de cette étape, vous avez terminé les deux premiers exercices. Vous devriez donc avoir mieux appréhendé la nature des liens pointant vers votre site et vers ceux de vos concurrents. [Début]

À venir : V. Maximisez votre capital Liens.

Partager sur Facebook

P.S. À noter également dans l'actualité de ces jours-ci, ce billet complémentaire de WebRankInfo intitulé : « Comment bien choisir sur quelle page un partenaire doit vous faire un lien » [Début]

stratégie de liens, stratégie de référencement, référencement, positionnement, Internet, Laboratoire de traduction

stratégie de liens, stratégie de référencement, référencement, positionnement, Internet, Laboratoire de traduction